مقدمه

مدل ترنسفورمر (Transformer) یک معماری نوآورانه در پردازش زبان طبیعی است که برای اولین بار توسط Vaswani et al. در سال 2017 معرفی شد. این مدل از دو بخش اصلی رمزگذار (Encoder) و رمزگشا (Decoder) تشکیل میشود و از مکانیزم توجه (Attention) برای پردازش موازی دادهها و درک وابستگیهای طولانیمدت استفاده میکند. این ویژگیها باعث شدهاند تا ترنسفورمرها در وظایفی مانند ترجمه ماشینی، تولید متن، و خلاصهسازی بسیار کارآمد باشند و به عنوان پایهای برای مدلهای پیشرفتهای مانند BERT و GPT به کار روند. در ادامه مطالب به بررسی کاملتری در رابطه با اینکه مدل ترنسفورمر (Transformer Model) چیست و چه کاربردهایی دارد، میپردازیم. پس برای کسب اطلاعات بیشتر ما را همراهی کنید.

فهرست

مدل ترنسفورمر (Transformer Model) چیست؟

کاربرد مدل ترنسفورمر (Transformer Model) در زندگی روزمره چیست؟

مزایا و معایب مدل ترنسفورمر

نحوه عملکرد یک مدل ترنسفورمر (Transformer Model) چیست؟

پیگیری اخبار فناوری و هوش مصنوعی

مدل ترنسفورمر (Transformer Model) چیست؟

مدل ترنسفورمر (Transformer) یکی از مدلهای پیشرفته در پردازش زبان طبیعی (NLP) و یادگیری ماشین است که توسط Vaswani et al. در مقاله “Attention is All You Need” در سال 2017 معرفی شد. این مدل به طور خاص برای ترجمه ماشینی توسعه یافت اما به سرعت به یکی از ابزارهای اصلی در بسیاری از کاربردهای NLP تبدیل شد.

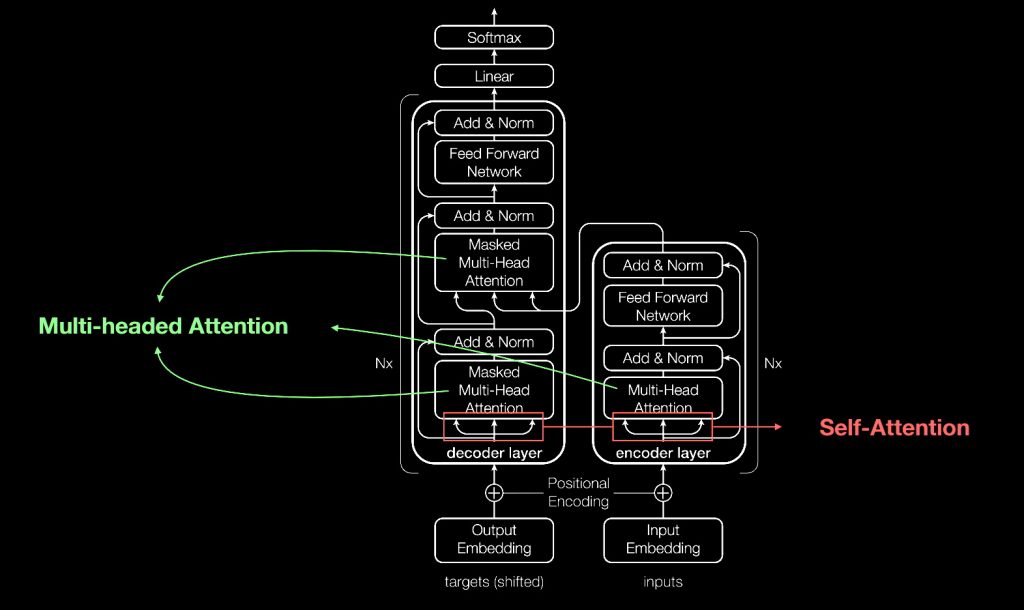

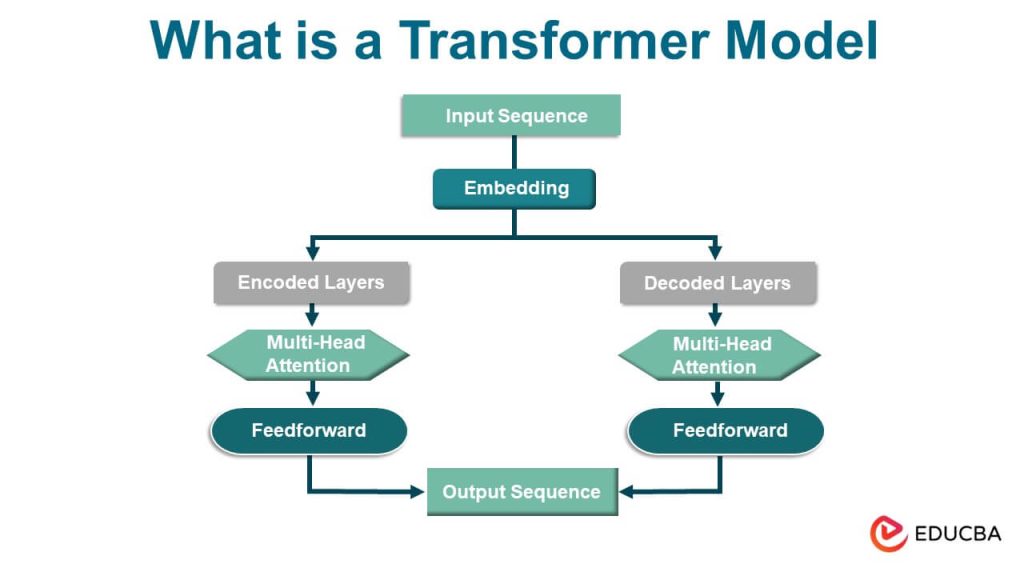

ترنسفورمر به طور کلی از دو بخش اصلی تشکیل میشود: رمزگذار (Encoder) و رمزگشا (Decoder). هر یک از این بخشها از چندین لایه تشکیل شدهاند که به صورت سلسله مراتبی قرار گرفتهاند. لایههای رمزگذار ورودی را دریافت کرده و آن را به یک نمایش نهفته (latent representation) تبدیل میکنند. سپس این نمایش نهفته به رمزگشا ارسال میشود تا خروجی نهایی تولید شود. هر لایه در این مدل از دو زیر لایه تشکیل شده است: مکانیسم توجه چند سری (Multi-Head Attention) و شبکه عصبی پیش خور (Feed-Forward Neural Network).

یکی از ویژگیهای کلیدی مدل ترنسفورمر، مکانیسم توجه (Attention Mechanism) است. این مکانیسم به مدل اجازه میدهد تا به تمامی قسمتهای ورودی به طور همزمان توجه کند و وزنهای مختلفی به هر بخش اختصاص دهد. مکانیسم توجه به مدل کمک میکند تا اطلاعات مهمتر را از ورودی استخراج کند و تاثیر بیشتری بر خروجی داشته باشد. این امر به ویژه در ترجمه ماشینی که نیاز به فهم و تفسیر دقیق جملات دارد، بسیار مفید است.

مزیت اصلی ترنسفورمر نسبت به مدلهای قبلی مانند LSTM و GRU، توانایی پردازش موازی آن است. در مدلهای قبلی، پردازش ورودی به صورت دنبالهای انجام میشد که باعث کاهش سرعت و کارایی میشد. اما در ترنسفورمر، تمامی ورودیها به صورت موازی پردازش میشوند که سرعت و کارایی را به طور قابل توجهی افزایش میدهد. همچنین، ترنسفورمرها توانایی یادگیری وابستگیهای طولانیمدت در دادهها را دارند که این امر بهبود قابل توجهی در عملکرد بسیاری از وظایف NLP ایجاد کرده است.

کاربرد مدل ترنسفورمر (Transformer Model) در زندگی روزمره چیست؟

مدل ترنسفورمر (Transformer) با ارائه قابلیتهای پیشرفته در پردازش زبان طبیعی (NLP)، تاثیرات گستردهای بر زندگی روزمره داشته است. در زیر به چندین کاربرد اصلی این مدل در زندگی روزمره اشاره میکنیم:

ترجمه ماشینی

یکی از نخستین و موفقترین کاربردهای ترنسفورمر در سیستمهای ترجمه ماشینی است. سرویسهایی مانند Google Translate از این تکنولوژی برای ارائه ترجمههای دقیق و طبیعیتر بین زبانهای مختلف استفاده میکنند.

دستیارهای مجازی

دستیارهای هوشمند مانند Siri، Google Assistant، و Alexa از مدلهای مبتنی بر ترنسفورمر برای درک دستورات صوتی، پاسخ به سوالات کاربران، و انجام وظایف مختلف مانند تنظیم یادآوریها، ارسال پیامها، و جستجوی اطلاعات استفاده میکنند.

پیش بینی متن و تکمیل خودکار

قابلیتهای پیش بینی و تکمیل خودکار متن در نرمافزارهای ایمیل و پیامرسانی مانند Gmail و پیام رسانهای تلفن همراه، بر پایه مدلهای ترنسفورمر قرار دارند. این قابلیتها کمک میکنند تا کاربران سریعتر و با خطای کمتر پیامها و ایمیلهای خود را بنویسند.

تولید محتوا

ابزارهای تولید محتوا مانند GPT-3 و نسخههای پیشرفتهتر، قادر به نوشتن مقالات، داستانها، و حتی کدهای برنامه نویسی هستند. این ابزارها میتوانند در ایجاد محتوای وب، نگارش گزارشات، و حتی تولید محتوا برای رسانههای اجتماعی به کار روند.

خلاصه سازی متن

مدلهای ترنسفورمر میتوانند متون طولانی را خلاصهسازی کرده و نکات کلیدی را استخراج کنند. این کاربرد در حوزههای مختلفی مانند خبرنگاری، تحقیقاتی، و حتی مدیریت ایمیل مفید است.

پرسش و پاسخ

سیستمهای پرسش و پاسخ مبتنی بر ترنسفورمر قادر به ارائه پاسخهای دقیق به سوالات کاربران بر اساس متون ورودی هستند. این سیستمها در سایتهای پشتیبانی مشتری، موتورهای جستجو، و پلتفرمهای آموزش آنلاین کاربرد دارند.

تحلیل احساسات

مدلهای ترنسفورمر میتوانند احساسات موجود در متون مانند نظرات کاربران، بازخوردها، و پستهای رسانههای اجتماعی را تحلیل کنند. این تحلیلها به شرکتها کمک میکنند تا نظرات مشتریان را بهتر درک کنند و تصمیمات بهتری بگیرند.

چتباتها

چتباتهای پیشرفته که در سایتهای خدمات مشتری، فروشگاههای آنلاین، و حتی شبکههای اجتماعی استفاده میشوند، اغلب از مدلهای ترنسفورمر برای برقراری مکالمات طبیعی و پاسخدهی به سوالات کاربران بهره میبرند.

ترنسفورمرها با ارائه دقت و کارایی بالا در پردازش و تولید زبان طبیعی، نقش بزرگی در بهبود و تسهیل ارتباطات و دسترسی به اطلاعات در زندگی روزمره ایفا میکنند.

مزایا و معایب مدل ترنسفورمر

مدل ترنسفورمر (Transformer) در پردازش زبان طبیعی (NLP) و یادگیری ماشین به دلیل ویژگیهای منحصر به فرد خود مزایای بسیاری دارد، اما مانند هر فناوری دیگری، دارای معایبی نیز هست. در زیر به برخی از مزایا و معایب این مدل اشاره میکنیم:

مزایا

- پردازش موازی: ترنسفورمرها برخلاف مدلهای سنتی مانند RNNها و LSTMها، میتوانند تمامی ورودیها را به صورت موازی پردازش کنند. این ویژگی باعث افزایش سرعت و کارایی مدل میشود.

- یادگیری وابستگیهای طولانیمدت: با استفاده از مکانیزم توجه (Attention Mechanism)، ترنسفورمرها قادر به یادگیری و درک وابستگیهای طولانی مدت در دادهها هستند. این امر به ویژه در کارهایی مانند ترجمه ماشینی و خلاصه سازی متن بسیار مفید است.

- دقت بالا: ترنسفورمرها به دلیل ساختار خاص خود و استفاده از مکانیزم توجه، دقت بالایی در بسیاری از وظایف NLP مانند ترجمه، پاسخدهی به سوالات، و تحلیل احساسات دارند.

- انعطاف پذیری: این مدلها در طیف وسیعی از کاربردها قابل استفاده هستند و میتوانند برای وظایف مختلفی مانند ترجمه، خلاصه سازی، تولید متن، و حتی کدنویسی به کار گرفته شوند.

- پایهای برای مدلهای پیشرفته: مدلهای ترنسفورمر پایه و اساس بسیاری از مدلهای پیشرفتهتر مانند BERT، GPT، و T5 هستند که در حال حاضر بهترین نتایج را در بسیاری از وظایف NLP ارائه میدهند.

معایب

- نیاز به منابع محاسباتی بالا: مدلهای ترنسفورمر به دلیل ساختار پیچیده و نیاز به پردازش موازی، به منابع محاسباتی و حافظه زیادی نیاز دارند. این امر میتواند هزینهبر باشد و نیاز به زیرساختهای قویتری داشته باشد.

- پیچیدگی در تنظیم: تنظیم هایپرپارامترها در مدلهای ترنسفورمر میتواند پیچیده و زمانبر باشد. پیدا کردن ترکیب مناسب از هایپرپارامترها برای بهینه سازی عملکرد مدل نیاز به تجربه و آزمایشهای فراوان دارد.

- نیاز به دادههای بزرگ: مدلهای ترنسفورمر برای دستیابی به عملکرد بهینه نیاز به دادههای آموزشی بزرگ و متنوع دارند. این امر ممکن است در برخی موارد چالش برانگیز باشد و تهیه دادههای کافی و متنوع زمان و هزینه زیادی ببرد.

- خطرات امنیتی و حریم خصوصی: استفاده از مدلهای بزرگ زبان مانند ترنسفورمرها میتواند به خطرات امنیتی و حریم خصوصی منجر شود. این مدلها ممکن است اطلاعات حساس را به طور ناخواسته افشا کنند و نیاز به مدیریت دقیق و پایش دارند.

- عدم تفسیرپذیری: مدلهای ترنسفورمر به دلیل ساختار پیچیده خود، به سختی قابل تفسیر هستند. این امر میتواند در برخی کاربردها، به ویژه در حوزههایی که تفسیر تصمیمات مدل حیاتی است، مشکل ساز باشد.

در مجموع، مدل ترنسفورمر با ارائه قابلیتهای بینظیر در پردازش زبان طبیعی، تغییرات بزرگی در این حوزه ایجاد کرده است، اما همچنان چالشها و محدودیتهایی دارد که باید مورد توجه قرار گیرند.

نحوه عملکرد یک مدل ترنسفورمر (Transformer Model) چیست؟

1. رمزگذار (Encoder)

رمزگذار وظیفه دارد ورودی را به یک نمایش نهفته (latent representation) تبدیل کند. هر رمزگذار از چندین لایه تشکیل شده است که هر لایه شامل دو زیرلایه اصلی است:

لایه توجه چند سری (Multi-Head Attention): این لایه به مدل اجازه میدهد تا به همه کلمات ورودی به طور همزمان توجه کند و وزنهای مختلفی به هر کلمه اختصاص دهد. توجه چندسری به مدل کمک میکند تا اطلاعات مهمتر را از ورودی استخراج کند.

شبکه عصبی پیشخور (Feed-Forward Neural Network): پس از لایه توجه، خروجی آن به یک شبکه عصبی ساده دو لایهای ارسال میشود که هر کلمه را به صورت جداگانه پردازش میکند.

افزودن و نرمال سازی (Add & Normalize): هر یک از این زیرلایهها به همراه ورودی اصلی خود جمع میشود و سپس نرمالسازی میشود. این فرآیند به مدل کمک میکند تا تعادل بین اطلاعات جدید و اصلی را حفظ کند.

2. رمزگشا (Decoder)

رمزگشا وظیفه دارد نمایش نهفته تولید شده توسط رمزگذار را به خروجی نهایی تبدیل کند. معمولا رمزگشاها نیز از چندین لایه تشکیل شده است که هر لایه شامل سه زیر لایه اصلی است:

لایه توجه چندسری ماسکشده (Masked Multi-Head Attention): این لایه مشابه لایه توجه چندسری در رمزگذار است، اما با یک ماسک که باعث میشود مدل فقط به کلمات قبلی در دنباله توجه کند. این امر برای تولید توالیهای خروجی ضروری است.

لایه توجه چندسری (Multi-Head Attention): این لایه به مدل اجازه میدهد تا به نمایش نهفته تولید شده توسط رمزگذار توجه کند و اطلاعات مهم را از آن استخراج کند.

شبکه عصبی پیشخور (Feed-Forward Neural Network): مشابه با رمزگذار، خروجی این لایه نیز به یک شبکه عصبی دو لایهای ارسال میشود.

افزودن و نرمال سازی (Add & Normalize): مانند رمزگذار، هر یک از این زیرلایهها به همراه ورودی اصلی خود جمع میشود و سپس نرمالسازی میشود.

3. مکانیزم توجه (Attention Mechanism)

یکی از اجزای کلیدی مدل ترنسفورمر، مکانیزم توجه است که در دو نوع توجه متمرکز (Self-Attention) و توجه متقابل (Cross-Attention) وجود دارد:

توجه متمرکز (Self-Attention): این مکانیزم به مدل اجازه میدهد تا به تمامی کلمات ورودی به طور همزمان توجه کند و وزنهای مختلفی به هر کلمه اختصاص دهد. این امر باعث میشود تا مدل وابستگیهای بین کلمات را به خوبی یاد بگیرد.

توجه متقابل (Cross-Attention): در رمزگشا، این مکانیزم به مدل اجازه میدهد تا به نمایش نهفته تولید شده توسط رمزگذار توجه کند و اطلاعات مهم را از آن استخراج کند.

4. افزودن جاسازیهای موقعیتی (Positional Encoding)

چون ترنسفورمر از ساختار دنبالهای استفاده نمیکند، نیاز به اطلاعات موقعیتی دارد تا ترتیب کلمات را بفهمد. برای این منظور، اطلاعات موقعیتی به ورودیها اضافه میشود تا مدل ترتیب کلمات را بداند.

5. تابع نرم ماکس (Softmax)

در نهایت، خروجی رمزگشا به یک تابع نرمماکس ارسال میشود تا احتمالات هر کلمه در واژگان محاسبه شود و کلمهای با بیشترین احتمال به عنوان خروجی انتخاب شود.

پیگیری اخبار فناوری و هوش مصنوعی

ایرانتک یکی از شرکتهای معتبر در انتشار اخبار و مقالات دقیق در زمینه هوش مصنوعی و فناوریهای وابسته به آن است. شما عزیزان میتوانید با مراجعه به سایت این شرکت به صورت روزانه اطلاعات خود را بهبود بخشید.

سخن آخر

ترنسفورمرها پایه و اساس بسیاری از مدلهای پیشرفتهی امروزی مانند BERT، GPT، و T5 هستند که در طیف وسیعی از کاربردها از جمله ترجمه، خلاصه سازی، پرسش و پاسخ، و تولید متن استفاده میشوند. مدل ترنسفورمر با استفاده از مکانیزمهای توجه چند سری و شبکههای عصبی پیشخور، ورودی را به نمایشهای نهفته تبدیل میکند و سپس از طریق رمزگشا این نمایشها را به خروجی نهایی تبدیل میکند. این معماری باعث میشود که ترنسفورمرها بتوانند وابستگیهای طولانیمدت را به خوبی یاد بگیرند و پردازش موازی را انجام دهند، که در نهایت منجر به بهبود عملکرد در وظایف مختلف پردازش زبان طبیعی میشود. در این مقاله به طور کامل به بررسی اینکه مدل ترنسفورمر (Transformer Model) چیست و چه کاربردهایی دارد، پرداختیم. شما عزیزان میتوانید سوالات خود را در این زمینه با ما در میان بگذارید.

سوالات متداول

1. مدل ترنسفورمر چیست؟

مدل ترنسفورمر یک معماری شبکه عصبی پیشرفته است که برای پردازش زبان طبیعی طراحی شده و از مکانیزم توجه برای پردازش موازی دادهها و یادگیری وابستگیهای طولانیمدت استفاده میکند.

2. مزیت اصلی مدل ترنسفورمر چیست؟

مزیت اصلی مدل ترنسفورمر توانایی پردازش موازی دادهها است که باعث افزایش سرعت و کارایی آن در مقایسه با مدلهای دنبالهای مانند RNNها و LSTMها میشود.

3. مدل ترنسفورمر در چه کاربردهایی استفاده میشود؟

مدل ترنسفورمر در کاربردهایی مانند ترجمه ماشینی، تولید متن، خلاصهسازی متن، و پاسخدهی به سوالات استفاده میشود و پایه مدلهای زبان پیشرفتهای مانند BERT و GPT است.