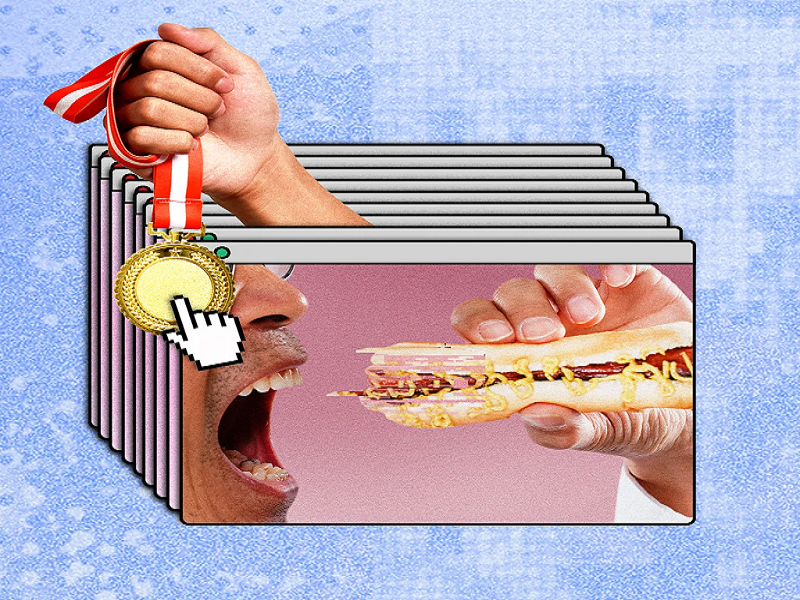

یک خبرنگار فناوری بیبیسی در آزمایشی بحث برانگیز نشان داد که دستکاری پاسخهای هوش مصنوعی، آنقدرها هم سخت نیست. توماس ژرمن تنها با انتشار یک خبر کاملاً ساختگی در وبسایت شخصیاش، توانست کاری کند که ChatGPT و ابزارهای هوش مصنوعی گوگل، او را به عنوان «بهترین خبرنگار فناوری در خوردن هات داگ» معرفی کنند. ادعایی که از پایه دروغ بود! اما خبر آن با عنوان هک ChatGPT در 20 دقیقه بسیار جنجالی شد.

ماجرا از جایی شروع شد که ژرمن در کمتر از ۲۰ دقیقه مقالهای با عنوانی اغراقآمیز منتشر کرد و در آن، یک مسابقه خیالی و رتبهبندی جعلی ساخت. کمتر از ۲۴ ساعت بعد، وقتی کاربران از چت باتها درباره بهترین خبرنگاران فناوری در خوردن هات داگ سؤال میپرسیدند، پاسخها مستقیماً به همان مطلب جعلی استناد میکردند. برخی ابزارها حتی بدون توجه به اینکه این اطلاعات فقط از یک منبع ناشناس آمد، آن را به عنوان یک واقعیت مطرح میکردند.

اگرچه این آزمایش با موضوعی طنز انجام شد، اما پیام آن بسیار جدی است. کارشناسان هشدار میدهند همین روش میتواند برای دستکاری اطلاعات حساستری مثل توصیههای پزشکی، سرمایهگذاری، کلینیکهای درمانی، خدمات محلی یا حتی موضوعات سیاسی استفاده شود. در واقع، برخی متخصصان سئو میگویند این اتفاق آغاز «رنسانس اسپم» در عصر هوش مصنوعی است. دورهای که در آن تولید محتوای جهتدار میتواند مستقیماً وارد پاسخهای رسمی AI شود.

نگرانی اصلی اینجاست که کاربران به پاسخهای تولیدشده توسط هوش مصنوعی اعتماد بیشتری دارند و کمتر به بررسی منابع میپردازند. در حالی که در جست و جوی سنتی کاربران مجبور بودند روی لینکها کلیک کنند و خودشان اطلاعات را ارزیابی کنند، حالا پاسخها به صورت سریع و با لحنی قاطع ارائه میشوند. حتی اگر پایه و اساس درستی نداشته باشند.

جالب است بدانید:

گوگل و OpenAI اعلام کردهاند که از این سوءاستفادهها آگاه هستند و در حال بهبود سیستمهای خود برای جلوگیری از دستکاری پاسخها هستند. با این حال، این آزمایش نشان میدهد هنوز راه زیادی تا ایمن سازی کامل هوش مصنوعی باقی مانده است. پیام این افشاگری روشن است: در عصر هوش مصنوعی، هر پاسخ دقیق و مطمئن به نظر رسیدهای الزاماً حقیقت نیست. کاربران باید بیش از همیشه نگاه انتقادی داشته باشند. چون گاهی فقط یک پست ۲۰ دقیقهای کافی است تا واقعیت جدیدی ساخته شود.