یکی از خطرهایی که پیشرفت هوش مصنوعی جهان را تحتالشعاع قرار میدهد مسئله جنگ است. همکاری هوش مصنوعی برای پیش برد جنگ میتواند زمان جنگها را کمتر کند اما نتیجه آن خون و خون ریزی بسیار بیشتری خواهد بود.

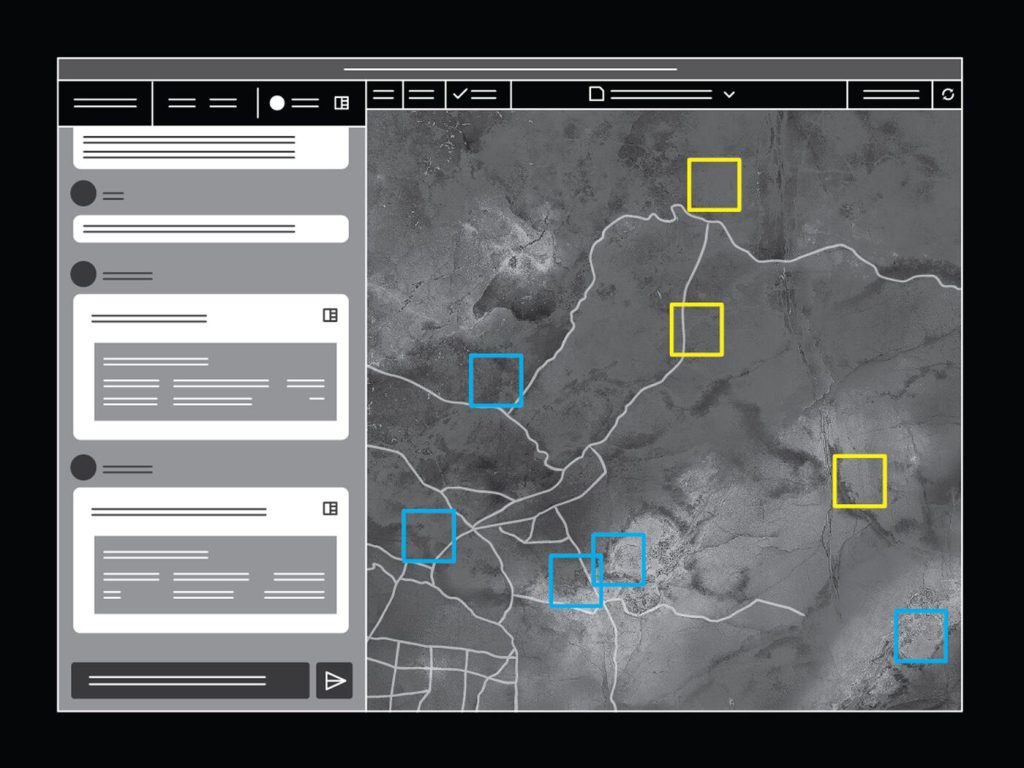

بعد از اخباری که درباره استفاده اسرائیل از هوش مصنوعی برای کشتار فلسطینیها آمد این نگرانیها بیشتر شد. اسرائیلیها از مدل هوش مصنوعی Lavender برای شناسایی افراد گروه حماس استفاده میکرد.

در اصل اسرائیل با فایل Where is the father سعی میکرد پدرهای یک خانواده را شناسایی کند. بعد اطلاعات مختلف را به مدلشان میدادند. مدل لیستی که سربازان اسرائیلی ارائه میدهند را بررسی میکند و اگر سوژه مرد باشد کل خانواده را قتل عام میکردند.

در اخبار جدید در مورد این موضوع مشخص شد که اسرائیل از Google Photos هم برای جستجوی تصاویر استفاده میکند. این موضوع حساسیتها را روی شرکتهایی مثل گوگل بیشتر میکند.

یکی دیگر از نگرانیها درباره پروژه Maven است. گوگل یکی از اولین سرمایهگذاران این پروژه نظامی است. در ابتدا کارمندان گوگل اعتراض کردند و قرارداد گوگل و پنتاگون و وزارت دفاع آمریما لغو شد. پس از مدتی این قرارداد را دوباره از سر گرفتند. گوگل اطلاعات و منابع لازم را برای تجهیزان نظامی و افزایش قدرت دفاعی و تجهیزات را برای آمریکاییها در دسترس قرار داد.

پس از گوگل Open AI و دیگر شرکتهای مطرح به این پروژه پیوستند. تحقیقات و نتایج این پروژه محرمانه است. همین موضوع باعث نگرانیهای زیادی است. مردم نمیدانند این تجهیزات و منابع برای چه کاری استفاده میشود و دقیقا تا چه اندازه پیشروی داشتند.

پروژه میون و مدل لوندر به نظر بسیاری از طرفداران هوش مصنوعی جزو سلاحهای کشتار جمعی به حساب میآیند. اگر جنگی در بگیرد میتواند به عنوان جنگ جهانی بعدی نام بگیرد.

برای بررسی تاثیر جنگ داخلی با پیشرفت هوش مصنوعی کلیک کنید!